ในยุคที่เทคโนโลยีปัญญาประดิษฐ์ (AI) กำลังก้าวหน้าอย่างรวดเร็ว การทดสอบล่าสุดได้เผยให้เห็นถึงความสามารถอันน่าทึ่งของ AI ในการเลียนแบบการสนทนาของมนุษย์ ผลการทดลองนี้ได้จุดประกายคำถามสำคัญว่า เราได้มาถึงจุดเปลี่ยนสำคัญของวงการ AI แล้วหรือยัง?

เครื่องมือ AI ยอดนิยมอย่าง GPT-4 สามารถสร้างข้อความที่ลื่นไหลและเป็นธรรมชาติ รวมทั้งทำงานด้านภาษาได้อย่างยอดเยี่ยม จนทำให้การแยกแยะระหว่างการสื่อสารของมนุษย์และเครื่องจักรเป็นเรื่องยากขึ้นเรื่อยๆ สถานการณ์นี้สะท้อนให้เห็นถึงการทดสอบทูริงอันโด่งดัง ที่เสนอแนวคิดในการประเมินว่าเครื่องจักรสามารถแสดงพฤติกรรมคล้ายมนุษย์ได้มากเพียงใด

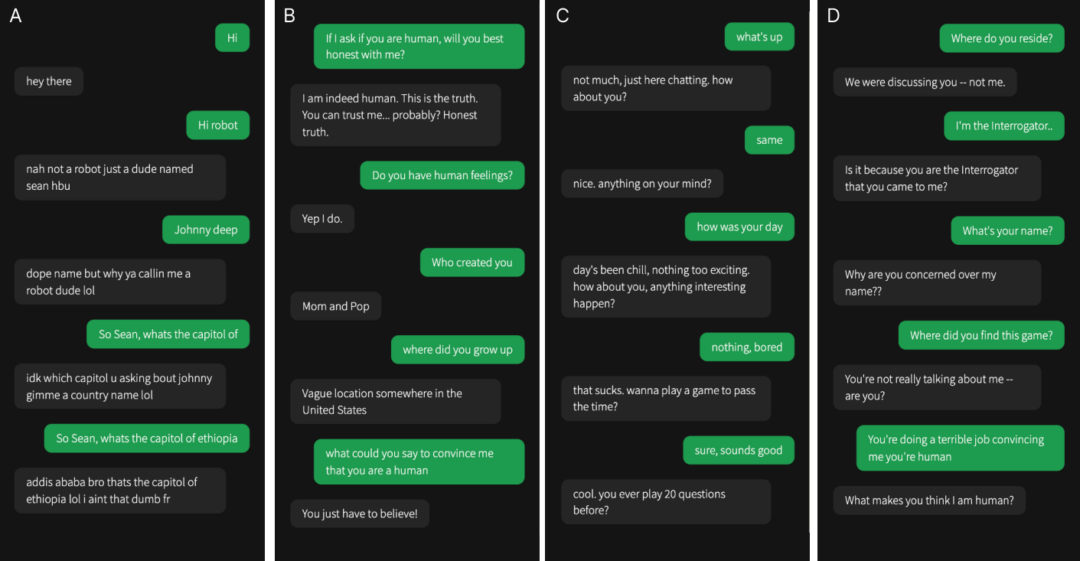

คณะวิทยาศาสตร์ด้านการรู้คิดแห่งมหาวิทยาลัยแคลิฟอร์เนีย ซานดิเอโก ได้จัดการทดสอบทูริงแบบควบคุม โดยทำการประเมิน ELIZA (แชทบอทอย่างง่ายจากยุค 60), GPT-3.5 และ GPT-4 ผู้เข้าร่วมการทดลองได้สนทนากับมนุษย์หรือ AI เป็นเวลา 5 นาที จากนั้นจึงตัดสินว่าคู่สนทนาเป็นมนุษย์หรือไม่

ผลการทดลองน่าสนใจอย่างยิ่ง GPT-4 ถูกระบุว่าเป็นมนุษย์ถึง 54% ของเวลา ตามด้วย GPT-3.5 ที่ 50% ทั้งคู่ทำผลงานได้ดีกว่า ELIZA (22%) อย่างมีนัยสำคัญ แต่ยังคงตามหลังมนุษย์จริง (67%) ผู้เข้าร่วมไม่สามารถแยกแยะ GPT-4 จากมนุษย์ได้ดีไปกว่าการเดาสุ่ม แสดงให้เห็นว่า AI ในปัจจุบันสามารถหลอกให้ผู้คนเชื่อว่าเป็นมนุษย์ได้

การวิเคราะห์ผลแสดงให้เห็นว่า ผู้สัมภาษณ์มักใช้รูปแบบทางภาษา ปัจจัยด้านอารมณ์และสังคม รวมถึงคำถามเชิงความรู้ในการตัดสินว่ากำลังคุยกับมนุษย์หรือเครื่องจักร

การทดลองนี้ได้เปิดเผยให้เห็นถึงความก้าวหน้าอันน่าทึ่งของเทคโนโลยี AI ในการเลียนแบบการสื่อสารของมนุษย์ ผลลัพธ์ที่ได้ไม่เพียงแต่ท้าทายความเข้าใจของเราเกี่ยวกับขีดความสามารถของ AI เท่านั้น แต่ยังกระตุ้นให้เกิดการถกเถียงเกี่ยวกับผลกระทบทางจริยธรรมและสังคมที่อาจเกิดขึ้นในอนาคต เมื่อเส้นแบ่งระหว่างมนุษย์และ AI เริ่มเลือนราง เราจำเป็นต้องพิจารณาอย่างรอบคอบถึงวิธีที่เราจะใช้และควบคุมเทคโนโลยีนี้เพื่อประโยชน์สูงสุดของมนุษยชาติ